灵妖游戏网:值得大家信赖的游戏下载站!

灵妖游戏网:值得大家信赖的游戏下载站!

发布时间:2026-03-27 13:21:50来源:灵妖游戏网作者:

美国东部时间3月26日,存储芯片股集体重挫,闪迪跌超11%,希捷跌逾8%,超威半导体、西部数据跌逾7%,美光科技跌近7%。

业内人士分析,这一波动源自谷歌研究院即将在国际学习表征会议(ICLR 2026)上正式亮相的学术论文,该研究推出了一种新型AI内存压缩技术“TurboQuant”。

谷歌宣称,该技术可将大语言模型推理中的缓存内存占用压缩至六分之一,并在英伟达H100 GPU上实现最高8倍的性能加速。

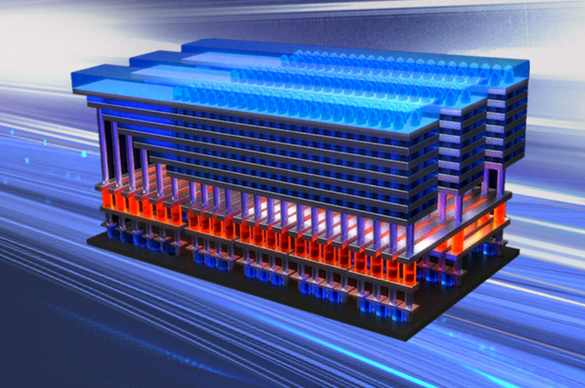

AI模型运行时存在一种“工作内存”,即KV缓存(Key-Value Cache)。每当模型处理信息、生成回答时,KV缓存便会迅速膨胀,且上下文窗口越长,缓存占用的内存越大。

TurboQuant本质上是一种极致的量化压缩算法,传统量化方法需要在压缩精度和额外存储开销之间妥协,而谷歌团队通过PolarQuant(极坐标量化)和QJL(量化JL变换)两项创新,实现了在“零损失”前提下将KV缓存压缩至3-bit精度。

Cloudflare首席执行官将这一成果称为谷歌的“DeepSeek时刻”,认为其有望像DeepSeek一样,通过极致效率大幅拉低AI的运行成本。

不过,摩根士丹利在最新研报中指出,市场对此存在误读。该技术仅作用于推理阶段的键值缓存,并不影响模型权重所占用的高带宽内存(HBM),也与AI训练任务无关。

分析师强调,所谓的“6倍压缩”并非存储总需求的减少,而是通过效率提升增加单GPU的吞吐量。这意味着在相同硬件条件下,可以支持4倍至8倍更长的上下文,或在不触发内存溢出的前提下显著提升批处理规模。

目前,谷歌尚未公布TurboQuant在Gemini等自研模型中的具体部署时间表,研究团队计划在下个月的ICLR 2026会议上正式发布相关成果。

火影忍者成人版 火影忍者:成人版幻想纪元

火柴人999999无限钻石版 火柴人999999无限钻石版:畅享无尽冒险

大侠立志传手机版大梁太学院答案大全

《黑白潜行2》定档1月25日 安志杰、曾志伟领衔主演

大侠立志传东南地区非叶家军路线事件一览

赛尔号布莱克解析 赛尔号布莱克深度解析

传奇3蚂蚁洞怎么去 传奇3蚂蚁洞探险指南

拳皇97山崎龙二 拳皇97山崎龙二角色深度解析

大航海时代2攻略 大航海时代2全面攻略

鸣潮云游戏官方版

角色扮演

植物大战僵尸融合版官方正版

战争策略

植物大战僵尸融合版屋顶版

战争策略

节奏盒子sprunki可爱版

音乐舞蹈

植物大战僵尸杂交魔改版

战争策略

欧布圆环模拟器

模拟经营

植物大战僵尸融合版正版

战争策略

三国谋定天下官网版

战争策略

头七怪谈中文版

冒险解谜